Meta: cómo respondió la empresa a las denuncias de "agresión sexual" en su mundo virtual

Meta: cómo respondió la empresa a las denuncias de "agresión sexual" en su mundo virtual

Meta: cómo respondió la empresa a las denuncias de "agresión sexual" en su mundo virtual

T13 En Vivo

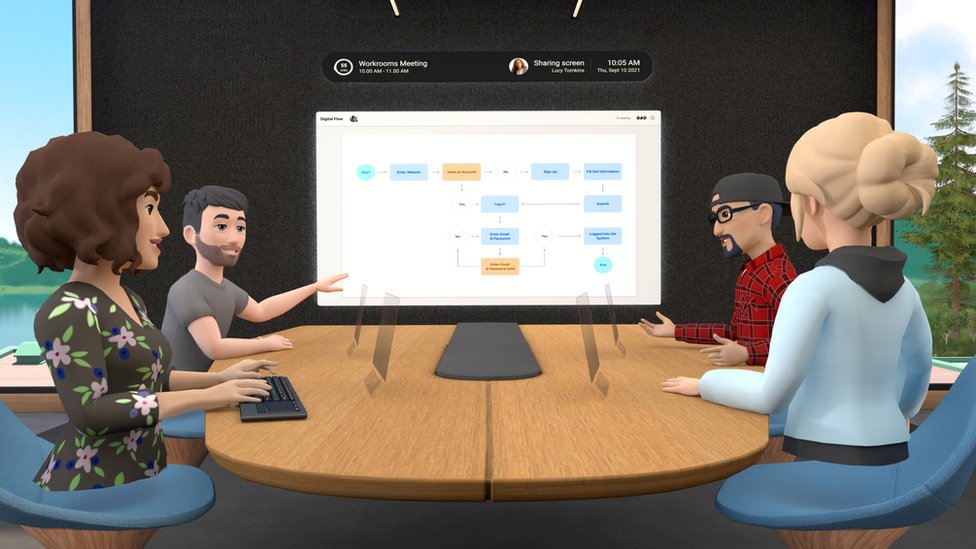

El metaverso aún se encuentra en la etapa de concepto, pero los últimos intentos de crear mundos virtuales ya se enfrentan a un problema ancestral: el acoso.

La columnista de tecnología de Bloomberg Parmy Olson le contó al programa Tech Tent de la BBC sobre sus propias experiencias "espeluznantes".

Y una mujer comparó su propia experiencia traumática en la realidad virtual con el abuso sexual.

Meta, la compañía de Mark Zuckerberg, ahora anunció una nueva función, Personal Boundary (en español, "Límite personal"), que comenzó a implementarse el 4 de febrero y evita que los avatares se acerquen a una distancia determinada, lo que crea más espacio personal para las personas y facilita evitar estas interacciones no deseadas.

Esta función evita que otros "invadan el espacio personal de tu avatar", dijo Meta.

"Si alguien intenta ingresar a tu 'límite personal', el sistema detendrá su movimiento hacia adelante cuando alcancen el límite".

Está disponible en el software Horizon Worlds y Horizon Venues de Meta.

La firma dijo que era un "poderoso ejemplo de cómo la realidad virtual tiene el potencial de ayudar a las personas a interactuar cómodamente", pero reconoció que hay más trabajo por hacer.

Para algunos, la noticia será bienvenida.

Miradas

"Tuve algunos momentos en los que fue incómodo para mí como mujer", dijo Olson sobre sus interacciones en realidad virtual.

Estaba visitando Horizon Worlds de Meta, su plataforma de realidad virtual donde cualquier persona mayor de 18 años puede crear un avatar y pasar el rato.

Para hacerlo, los usuarios necesitan uno de los dispositivos de realidad virtual de Meta, y el espacio ofrece la posibilidad de jugar y chatear con otros avatares, ninguno de los cuales tiene piernas.

"Pude ver de inmediato que era la única mujer, el único avatar femenino. Y estos hombres me rodearon y me observaron en silencio", le dijo Olson a Tech Tent.

"Luego comenzaron a tomarme fotos y a dármelas, y tuve un momento en que un tipo se acercó a mí y me dijo algo", continuó.

"En la realidad virtual, si alguien está cerca de ti, entonces la voz suena como si alguien literalmente te estuviera hablando al oído. Y me tomó por sorpresa", agregó.

Olson experimentó una incomodidad similar en la plataforma de realidad virtual social de Microsoft.

"Estaba hablando con otra mujer y, a los pocos minutos de haber charlado, un chico se acercó y comenzó a hablarnos y a seguirnos diciendo cosas inapropiadas, y tuvimos que bloquearlo", dijo.

"Desde entonces he oído hablar de otras mujeres que han tenido experiencias similares", sostuvo.

La columnista de tecnología indicó que aunque no lo describiría como acoso, era "espeluznante e incómodo".

Abuso sexual

Nina Jane Patel fue mucho más allá días atrás cuando le dijo al Daily Mail que fue abusada en Horizon Venues, comparándolo con una agresión sexual.

Patel describió cómo un grupo de avatares masculinos la "tocaron" y la sometieron a una seguidilla de insinuaciones sexuales. La fotografiaron y le enviaron un mensaje que decía: "No finjas que no te encantó".

Meta respondió al periódico diciendo que lo sentía: "Queremos que todos tengan una experiencia positiva y encuentren fácilmente las herramientas de seguridad que pueden ayudar en una situación como esta, y que nos ayuden a investigar y tomar medidas".

Oportunidades y amenazas del metaverso

Moderar contenido en el naciente metaverso será un desafío, y el director de tecnología de Meta, Andrew Bosworth, admitió que ofrecería "mayores oportunidades y mayores amenazas".

"Podría parecer mucho más real para mí si estuvieras abusando de mí, porque se siente mucho más como un espacio físico", dijo en una entrevista con la BBC a fines del año pasado.

Pero aseguró que las personas en roles virtuales tendrían "mucho más poder" sobre sus entornos.

"Si tuviera que silenciarte, dejarías de existir para mí y tu capacidad para hacerme daño se anularía de inmediato", afirmó.

Bosworth cuestionó si la gente querría el tipo de moderación que existe en plataformas como Facebook cuando tienen chats en realidad virtual.

"¿Realmente quieres que el sistema o una persona te esté escuchando? Probablemente no", se preguntó y respondió al mismo tiempo.

"Así que creo que tenemos una compensación de privacidad: si deseas tener un alto grado de contenido, seguridad o lo que llamaríamos integridad, bueno, eso se compensa con la privacidad".

Y en la visión de Meta del metaverso, donde diferentes salas están a cargo de diferentes compañías, la compensación se vuelve aún más compleja a medida que las personas se mudan del mundo virtual controlado por Meta, a otros.

"No puedo dar garantías sobre la privacidad ni la integridad de esa conversación", dijo.

Olson estuvo de acuerdo en que iba a ser "algo muy difícil de solucionar para Facebook, Microsoft y otros".

"Cuando estás escaneando texto en busca de discurso de odio, es difícil pero se puede hacer; puedes usar algoritmos de aprendizaje automático", dijo.

"(En cambio,) procesar información visual sobre un avatar o qué tan cerca está uno de otro, eso va a ser muy costoso computacionalmente, va a consumir mucha potencia informática; no sé qué tecnología puede hacer eso", razonó.

La ética de los mundos virtuales

Facebook está invirtiendo US$10.000 millones en sus planes de metaverso y parte de eso deberá seguir construyendo nuevas formas de moderar contenido.

"Hemos aprendido mucho en los últimos 15 años de discurso en internet (...) así que vamos a traer todo ese conocimiento para hacer lo mejor que podamos para construir estas cosas desde cero, para darle a la gente una mucho control sobre su propia experiencia", dijo Bosworth a la BBC.

Beth Singler, antropóloga de la Universidad de Cambridge que ha estudiado la ética de los mundos virtuales, dijo: "Facebook ya falló al aprender sobre lo que sucede en los espacios en internet. Sí, han cambiado algunas de sus políticas, pero todavía hay material por ahí que no debería estar".

Hay más que aprender de los juegos, piensa, donde Second Life y World of Warcraft han ofrecido mundos virtuales durante años, limitando con quién pueden hablar los avatares y los nombres que pueden elegir para ellos.

La decisión de Meta de usar avatares sin piernas también puede ser deliberada, opina, muy probablemente una decisión técnica sobre la falta de sensores para las piernas, pero también podría ser una forma de limitar los problemas "de la cintura hacia abajo" que podrían surgir en caso de tener una presencia física completa.

Sin embargo, tener reglas estrictas sobre cómo se ven los avatares puede traer sus propios problemas para aquellos que "tratan de expresar una cierta identidad", agregó.