Cómo las grandes tecnológicas silenciaron a Trump y el debate de la libertad de expresión que generó

Cómo las grandes tecnológicas silenciaron a Trump y el debate de la libertad de expresión que generó

Cómo las grandes tecnológicas silenciaron a Trump y el debate de la libertad de expresión que generó

T13 En Vivo

El cierre de la cuenta de Twitter de Donald Trump después de que partidarios del presidente asaltaran el Capitolio el 6 de enero fue denunciada por unos y celebrado por otros.

Como cabe esperar, entre los críticos de la decisión abundan los seguidores del presidente estadounidense, si bien estos no son los únicos que han hecho sonar voces de alarma.

La canciller Ángela Merkel -a quien nadie describiría como cercana a Trump- se refirió a la medida como "problemática" por limitar "el derecho fundamental a la libre expresión" de su colega norteamericano.

Mientras que el activista ruso Alexei Navalny recurrió al mismo Twitter para denunciarla como "un acto inaceptable de censura", en un ejemplo de la preocupación que la medida ha generado entre algunos defensores de la libertad de expresión, especialmente en países donde la misma no está garantizada.

"Obviamente Twitter es una empresa privada, pero hemos visto muchos ejemplos en Rusia y China de empresas privadas que se han convertido en las mejores amigas del Estado y facilitadoras de la censura", explicó en su post Navalny.

Aunque, para otros, lo más preocupante es precisamente que una empresa privada básicamente haya podido mandar a callar al que se supone es el hombre más poderoso del mundo.

"El hecho de que un director ejecutivo pueda desconectar el altavoz del presidente de los Estados Unidos sin ningún control y el equilibrio es desconcertante", escribió el comisionado de la Unión Europea, Thierry Breton, en un artículo de opinión publicado en Politico.

Y hasta el ministro de Salud de Reino Unido, Matt Hancock, terció en el debate, advirtiendo sobre los riesgos de que las plataformas tecnológicas "decidan quién debe y quién no debe tener voz".

Referencias a la censura y la libertad de expresión también han sido frecuentes en las críticas de los simpatizantes de Trump, los que además han sido objeto de medidas similares en diversas redes sociales.

Twitter anunció el lunes el cierre de "más de 70.000 cuentas" vinculadas a QAnon, la teoría de la conspiración que ya antes de las elecciones también había sido objeto de bloqueos y cierres en Facebook.

La red social de Mark Zuckerberg también suspendió temporalmente, la cuenta de Trump y lo mismo hicieron Instagram, Snapchat, Twitch y también YouTube.

Facebook dijo además que también estaba eliminando todo el contenido que menciona la expresión "Stop the Steal" ("Paren el robo"), el lema asociado con las afirmaciones infundadas de Trump de que las elecciones presidenciales de noviembre pasado fueron manipuladas.

Y por si eso fuera poco para el trumpismo, la decisión de Amazon de dejar de proveer servicios de hospedaje en línea a Parler obligó al cierre temporal de esta alternativa a Twitter, especialmente popular entre los seguidores del presidente estadounidense.

El futuro de Parler está además comprometido por la decisión de Google y Apple de dejar de ofrecer la aplicación en sus tiendas virtuales, así como la negativa de muchos otros proveedores de hospedaje en línea de facilitarles espacio.

"La libertad de expresión está muerta y bajo el control de los grandes señores de la izquierda", fue el resumen de la situación que hizo -en Twitter- el hijo mayor del presidente, Donald Trump Jr.

Aunque como recuerda David Díaz-Jogeix, director de programas de la ONG de defensa de libertad de expresión Article 19, incluso en las sociedades democráticas más avanzadas esta libertad está sujeta a ciertos límites que Trump (y varios de sus seguidores) parecen haber traspasado.

"En un inicio se eliminaron mensajes por el riesgo inminente y real de violencia. Ese es el elemento determinante", destacó Díaz-Jogeix, quien también considera obligatorio considerar el inmenso número de seguidores de Trump y su posición de influencia.

"En ese contexto, la eliminación de esos tuits tiene sentido. Y la suspensión de la cuenta es grave, pero legítima, aunque podría ser desproporcionada. Y digo 'podría ser' porque no sabemos si se trata de una suspensión permanente o indefinida", le dijo a BBC Mundo.

La potencial amenaza de violencia también fue el principal argumento esgrimido por Amazon Web Services (AWS) para explicar su decisión de dejar de prestarle sus servicios a Parler.

"Es evidente que en Parler hay una significativa cantidad de contenido que fomenta e incita a la violencia contra otros, y que Parler no puede o no está dispuesto a identificar y eliminar rápidamente este contenido, lo que constituye una violación de nuestros términos de servicio", argumentó Amazon.

Parler, que anunció una demanda contra Amazon, sostiene por su parte que las verdaderas razones fueron "animadversión política" y para "reducir la competencia en el mercado de servicios de microblogging en beneficio de Twitter".

En cualquier caso, como explica la investigadora de ética y tecnología Stephanie Hare, esta no es la primera vez que una importante empresa de tecnología de EE.UU. toma medidas similares.

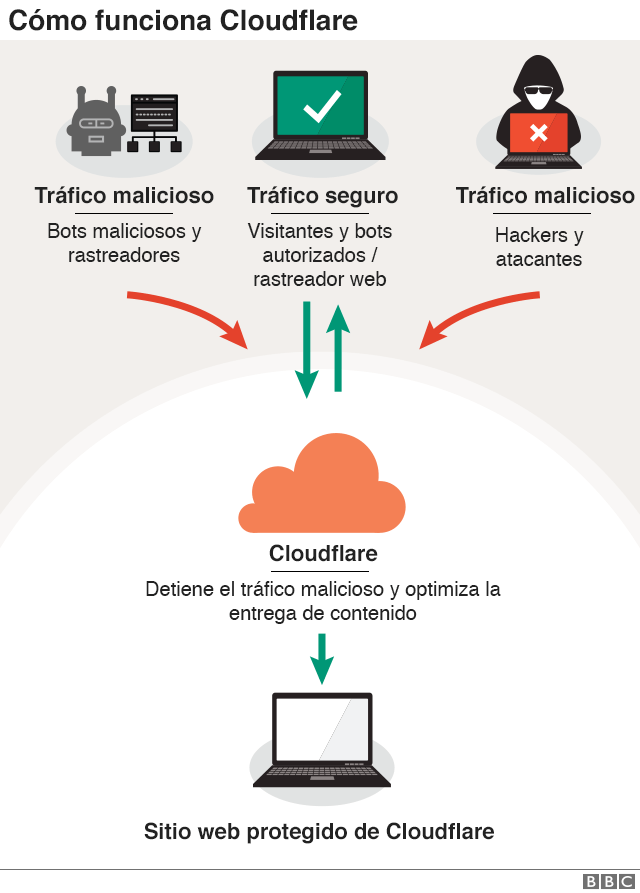

"Cloudflare dejó de proporcionarle servicios de entrega contenido, protección y soporte al sitio web de supremacistas blancos The Daily Stormer en 2017 y a 8Chan en 2019, después ese sitio web fuera utilizado por el perpetrador de una masacre en El Paso, Texas", destacó Hare.

Mientras que Díaz-Jogeix recordó que Twitter se reserva el derecho a restringir el acceso a su plataforma conforme en sus normas comunitarias y términos de servicio, lo que sin embargo podría ser legalmente cuestionable.

"En Europa, ha habido varios casos donde algunas redes han retirado a gente de sus plataformas -no en Twitter, pero en otros casos, creo que es Facebook; en Italia, Polonia y Alemania- y la gente las han llevado a juicios y los jueces han forzado a las plataformas a devolverles el espacio", contó el experto de Article 19

"Pero falta jurisprudencia por parte del Tribunal Europeo de Derechos Humanos, y también en EE.UU., de si existe la obligación de darle espacio en esas plataformas a individuos", le dijo a BBC Mundo

Para Santiago Pardo Rodríguez, coordinador del Laboratorio de Diseño para la Justicia de la Universidad de los Andes, en el caso del cierre de la cuenta de Trump hay otros elementos particulares a considerar que hacen todavía más complejo el caso.

Como explica el constitucionalista colombiano en un interesante hilo en Twitter, en 2017 el Instituto Knight para la Primera Enmienda de la Universidad de Columbia demandó a Trump por bloquear a siete personas de su cuenta de Twitter.

Un año después un juez les dio la razón a los demandantes y en 2019 otra Corte confirmó que Trump no podía bloquear a nadie de su cuenta de Twitter por constituir esta un "foro público": un espacio donde la libertad de expresión goza de amplias protecciones constitucionales frente a las acciones del gobierno asentadas en la jurisprudencia de la Corte Suprema de Justicia de EE.UU.

"¿Y la pregunta ahora es: se extienden esas protecciones constitucionales a empresas privadas? Yo creo que es un debate muy interesante y algo que se tiene que discutir", le dijo Pardo a BBC Mundo.

"Pero ahí es donde también entra el caso Brandenbrurg, que también menciono en el hilo, el que crea una regla que dice que el gobierno sí puede limitar contenidos en condiciones muy específicas: cuando existe una inminencia de que ese discurso violento pueda producir una acción ilegal", agregó.

Eso, sin embargo, también plantea la pregunta de por qué Twitter no debió actuar antes.

Pero sobre también la cuestión de si este tipo de decisión se puede dejar exclusivamente en manos de unas redes sociales que han sido acusadas al mismo tiempo de limitar la libertad de expresión y de no hacer lo suficiente.

Efectivamente, hasta ahora una de las reglas clave de plataformas como Facebook y Twitter había sido la de no interferir con el contenido publicado por los políticos por considerarlo demasiado importante para el discurso público, lo que se traducía en que usuarios de alto perfil -como el presidente de EE.UU.- gozaban de más latitud que otros usuarios.

Pero desde el inicio de la pandemia de coronavirus las cosas empezaron a cambiar significativamente, y las empresas empezaron a tomar más medidas contra los líderes mundiales.

En marzo, Facebook y Twitter eliminaron publicaciones del presidente brasileño Jair Bolsonaro y del presidente venezolano Nicolás Maduro por desinformación sobre la covid-19.

Pero no fue hasta mayo, en el contexto de las protestas de Black Lives Matter que Twitter tomó acciones contra un mensaje publicado Trump, colocándole una advertencia a un mensaje que según sus moderadores glorificaba la violencia: "Cuando comienza el saqueo, comienza el tiroteo".

Y las acciones de este tipo, que se multiplicaron durante la campaña electoral estadounidense, han aumentado todavía más a nivel global desde los sucesos del 6 de enero, con Facebook anunciando el lunes la eliminación de cuentas vinculadas al gobierno de Uganda que supuestamente se estaban utilizando para manipular las próximas elecciones.

Para la abogada y tecnóloga de privacidad Whitney Merrill esto apunta a un cambio en la postura de moderación de los gigantes tecnológicos.

"Las reglas y pautas de las redes sociales están evolucionando con el tiempo, lo que es normal, Pero no se están aplicando de manera consistente en todo el mundo", le dijo a la BBC.

Merill, sin embargo, anticipa que el castigo a Trump podría ser el comienzo de una purga de comportamientos similares a nivel mundial.

Y el presidente electo de EE.UU., Joe Biden, ya ha dicho que le gustaría cambiar la llamada Sección 230 -una ley que exonera en gran medida a las redes sociales de responsabilidad por las publicaciones de sus usuarios- para aumentar la moderación de contenidos y reducir la diseminación de noticias falsas.

Más legislación es también lo que propone la Unión Europea.

De hecho la crítica de Merkel a la acción de Twitter contra Trump -hecha a través de su portavoz, Steffen Seibert- destacó que la libertad de expresión solo puede restringirse "de acuerdo con la ley y dentro de un marco definido por los legisladores" y no "por decisión de los administradores de las plataformas de redes sociales".

Y David Díaz-Joegix coincide en que el gran problema de las condiciones de servicio y normas comunitarias que regulan la relación con las redes sociales es que las mismas no se basan en los estándares internacionales de derechos humanos.

"No pueden ser una decisión para (Mark) Zuckerberg o Jack (Dorsey), el CEO de Twitter, sino que deben basarse en estándares internacionales", le dice a BBC Mundo.

Pero para Artículo 19, también existe un riesgo en dejar la regulación de estas plataformas en manos de los gobiernos,

"Nosotros no queremos que Twitter o Facebook sean los que decidan quienes pueden disfrutar de la libertad de expresión. Pero tampoco nos parece buena idea que lo hagan los gobiernos, porque la historia ha demostrado que dejar que los gobiernos regulen la libertad de expresión es una mala idea", dice Díaz-Jogeix.

"Y lo que queremos es refocalizar toda esta discusión global que está habiendo sobre esto en preguntarse qué es lo que dicen los estándares internacionales de derechos humanos, en materia de libertad de expresión, pero también de respeto a la privacidad por ejemplo", concluye.